1. 介绍

摘要:

介绍了一个以文本作为条件,生成高保真、长时间片的音乐音频。比如文本为“由扭曲的吉他重复段伴奏的平静的小提琴旋律”,MusicLM可以可以根据文本条件,生成24kHz采样率,分钟级别的连续音乐音频。

从摘要中可以得知,这篇文章解决的根本问题其实可以非常简单的形容,就是:

如果加上一些限制条件,那么这个问题可以补充为:

假如将这个问题交给普通人来解决,相信很多没有基本乐理知识的人,都很难根据特定的文本,创作出一段长达几分钟的乐曲。

算法模型与人相同的是,它也很难学会乐理知识;但是算法模型比人类强大的地方,在于强大的模仿能力,它可以通过大量的数据,模仿文本和对应音乐的关联。

从文章里面可以了解到,虽然可以设计模仿能力突出的算法模型,但是解决这个问题依然充满了挑战,主要集中在以下两方面:

- 当前学术界的研究只能生成简单场景的短片段语音,因此将单文本转化为高保真和长时间连续的音乐片段具有很强的挑战

- 缺乏丰富的“音乐-文本”结对的数据集

2. 背景

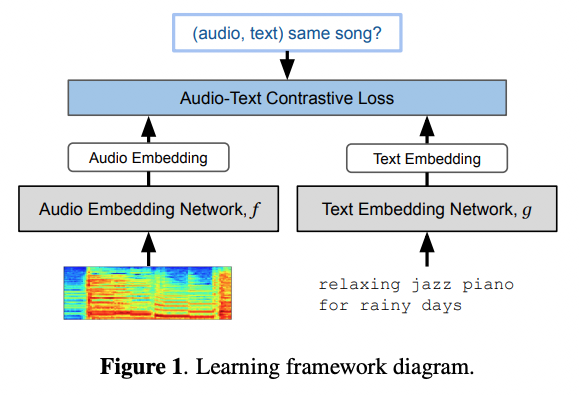

2.1 MuLan model

MuLanModel通过AudioEmbeding编码音频,通过TextEmbedding编码文本,将audio和text拉齐到同一维度空间,最后计算对比损失函数比较两者在同一维度空间的差别。

2.2 AudioLM

AudioLM使用SoundStream生成Acoustic tokens,用来合成高质量音频;

使用w2v-BERT生成Semantic tokens,用来维护音频的长期连续性。

分成3个阶段渐进式的合成声音:第1各阶段仅使用semantic tokens;第2个阶段使用semantic tokens + 粗糙的acoustic tokens合成音频; 第3个音频使用semantic tokens + fine acoustic tokens合成音频。

3. 方法

针对上面两个问题,作者首先制作了包含5千多条“音乐-文本“对应的MusicCaps数据集;然后通过下图的方式使用3个预训练模型,利用SoundStream保证高保真,w2v保证长时间连续,利用MuLan将文本和音频编码到同一个维度空间,使得二者具有可对比性。

作者设计的模型如下图所示,模型结构分为两个阶段:

第一阶段是语义模型阶段,音频通过MuLan模型生成MuLan tokens, 然后通过语义模型映射为w2v-BERT的Semantic tokens;

第二阶段是声学模型阶段,将MuLan tokens和Semantic token一起输入声学模型,并映射为SoundStream的Acoustic tokens,为了保证长时间连续音频生成,生成过程是一个类似audioLM的coarse-to-fine阶段。

4. 结果

- 两阶段建模的模型都是transformer-decoder only,24 layers, 16 attention heads,

- MuLan使用的开源模型,使用 Free Music Archive (FMA) dataset 训练SoundStream and w2v-BERT;

- AudioLM两阶段模型训练:five million audio clips(~280k hours)。semantic stage,随机裁剪30s音频;acoustic stage,随机裁剪10s音频;AudioLM细粒度的建模基于3s音频。

5. 评价

- 没开源代码,无法论证真实性能和效果

- 只是demo,和ChatGPT相比,距离商业化还有很大差距

- 现在就差text-2-video了

AI text-2-essayAI test-2-codeAI text-2-imageAI text-2-music- AI text-2-video

6. 参考

- MusicLM demo page

本文链接:https://my.lmcjl.com/post/10437.html

4 评论