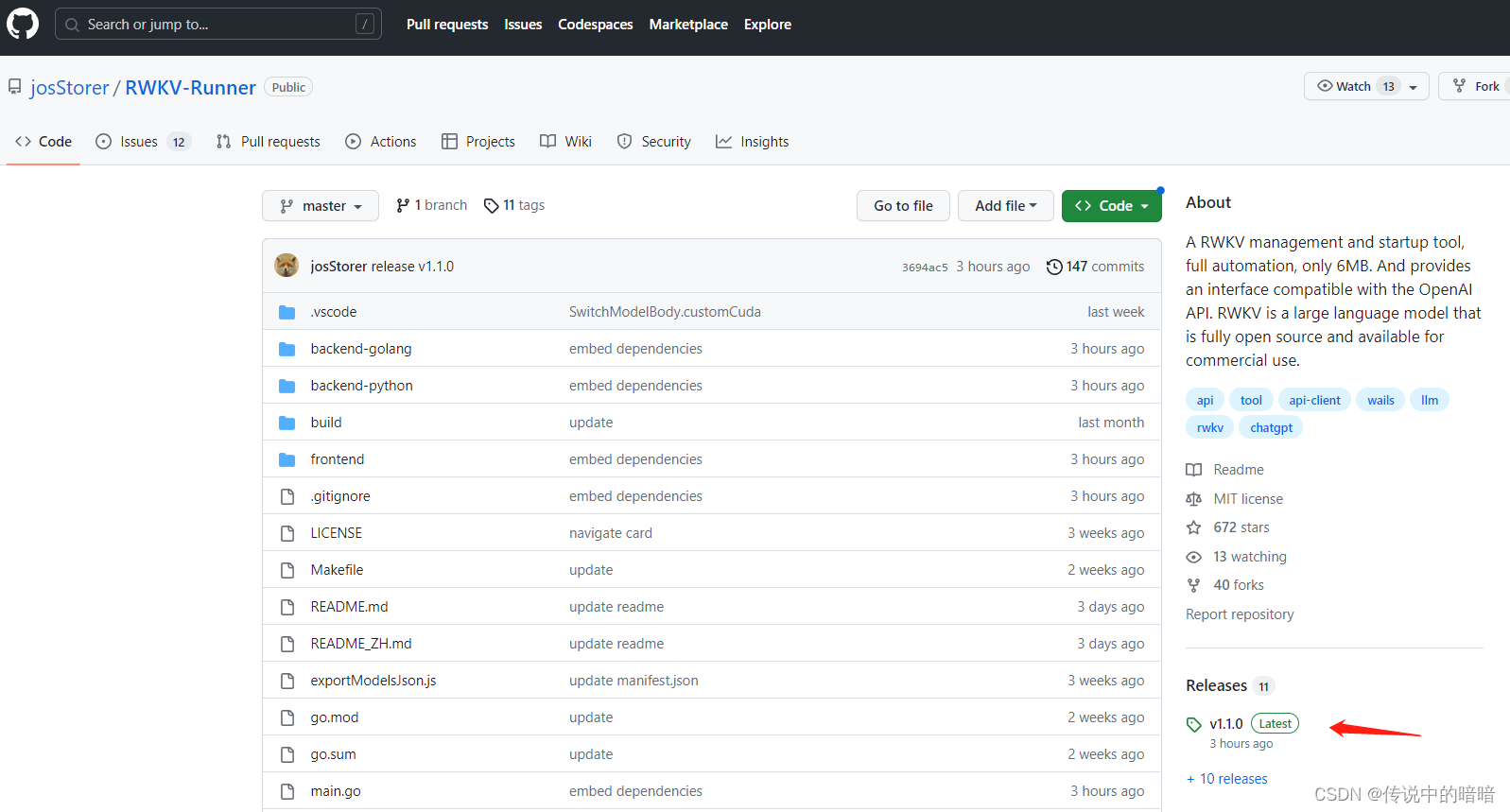

之前由于ChatGpt处处受限,又没法注册的同学们有福了,我们可以在自己电脑上本地化部署一套AI语言模型,且对于电脑配置要求也不是非常高,对它就是RWKV。 关于RWKV RWKV是一个开源且允许商用的大语言模型,灵活性很高且极具发展潜力,它是一种纯 RNN 的架构,能够进行语言建模,目前最大参数规模已经做到了 14B,该模型训练由Stability赞助。本文发布时R 继续阅读

Search Results for: 本地部署

查询到最新的12条

【类ChatGPT】本地CPU部署中文羊驼大模型LLaMA和Alpaca

昨天在github上看到一个在本地部署中文大模型的项目,和大家分享一下。先把地址po出来。 项目名称:中文LLaMA&Alpaca大语言模型+本地部署 (Chinese LLaMA & Alpaca LLMs) 项目地址:https://github.com/ymcui/Chinese-LLaMA-Alpaca 以下是原github中给出的体验GIF,可以看到这个模型还是具备一定的指令理解和上下文对话能力的。 继续阅读

无需GPU无需网络“本地部署chatGPT”(更新中文模型)

想当初图像生成从DELL到stable diffusion再到苹果的移动部署过了两三年吧 聊天bot才发展几个月就可以边缘部署了,如果苹果更新silicon,npu和运存翻倍,争取apple watch也能本地内置,最快ios18 mac、ipad、iPhone能内置吧 又是一个平民百姓都高兴的开源项目,chatGPT这种级别的模型甚至能部署到树莓派上运行,然后在操作的过程中也遇到一些问题,这篇就是 继续阅读

ChatGPT本地部署(支持中英文,超级好用)!

今天用了一个超级好用的Chatgpt模型——ChatGLM,可以很方便的本地部署,而且效果嘎嘎好,经测试,效果基本可以平替内测版的文心一言。 目录 一、什么是ChatGLM? 二、本地部署 2.1 模型下载 2.2 模型部署 2.3 模型运行 2.3.1 直接在命令行中输入进行问答 2.3.2 利用 gradio 库生成问答网页 三、模型与ChatGPT和GPT4AII 效果对比 3.1 ChatGLM 继续阅读

云服务器部署企业版openGauss,本地Data Studio远程连接

1.下载安装包 在华为云上租一台服务器,操作系统选:openEuler 20.03 64bit (64-bit) 获取openGauss Server安装包,企业版:软件包链接 使用xshell连接服务器,准备软硬件安装环境。准备软硬件安装环境 教程 下载Data Studio_5.0.0:软件包(在openGauss Tools一栏) 2.服务器安装 - 单节点安装 ①创建cluster_conf 继续阅读

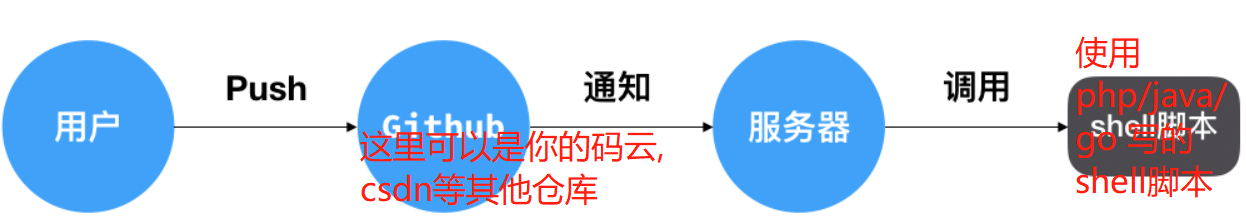

GO 使用Webhook 实现github 自动化部署的方法

通常大家开发大部分是本地git push 提交,服务器上git pull 手动更新。git 可以使用webhook实现自动部署。 webhook是仓库平台的一个钩子事件,通过hook 钩子监听代码,回调通知(通知地址就是你在各个git仓库平台中填写的webhook地址,一般在你的某个项目仓库如myproject.git里面的设置中)仓库平台填写的地址。 其实原理流程就是: 所以自动部署主要实现方式就是: - 修改代码 push - gi 继续阅读

chatGPT:12.12 之后更新的 chatGPT 的本地部署和接口调用,解决 response 403

文章目录问题源代码改动Session token 的获取cf_clearance 的获取user-agent 的获取将 config.json.sample 内容修改并移动位置附注:环境配置python >= 3.7特别提示playwright & cf_clearancerevChatGPT 版本httpxOpenAIAuth删除 import 中的错误后记 问题 因为 chatgpt 在 12.12 号更新了版本,因此整个源代码中增 继续阅读

腾讯云部署清华大学ChatGLM-6B实战

简介(来自官方) ChatGLM-6B 是一个开源的、支持中英双语的对话语言模型,基于 General Language Model (GLM) 架构,具有 62 亿参数。结合模型量化技术,用户可以在消费级的显卡上进行本地部署(INT4 量化级别下最低只需 6GB 显存)。 ChatGLM-6B 使用了和 ChatGPT 相似的技术,针对中文问答和对话进行了优化。经过约 1T 标识符 继续阅读

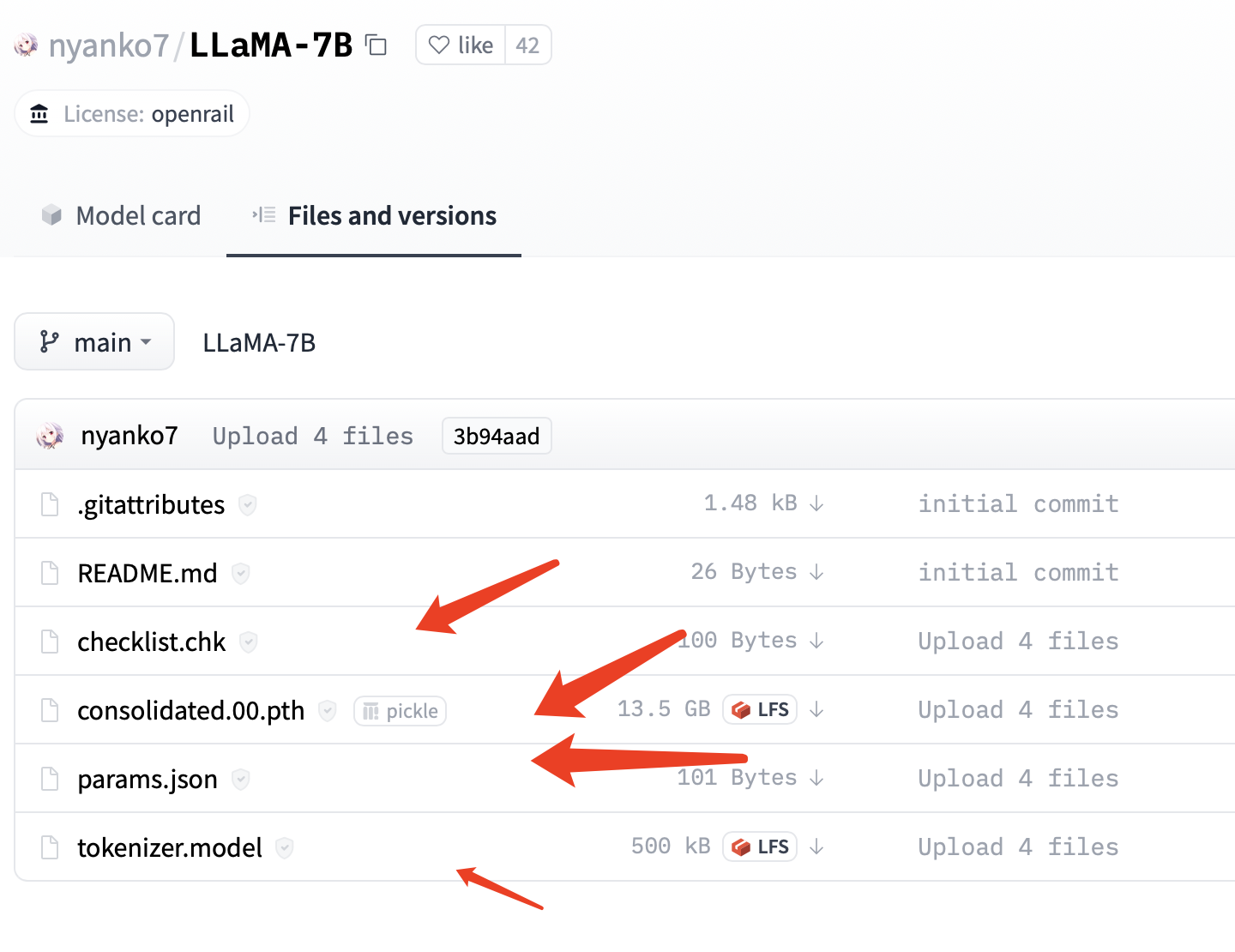

本地推理,单机运行,MacM1芯片系统基于大语言模型C++版本LLaMA部署“本地版”的ChatGPT

OpenAI公司基于GPT模型的ChatGPT风光无两,眼看它起朱楼,眼看它宴宾客,FaceBook终于坐不住了,发布了同样基于LLM的人工智能大语言模型LLaMA,号称包含70亿、130亿、330亿和650亿这4种参数规模的模型,参数是指神经网络中的权重和偏置等可调整的变量,用于训练和优化神经网络的性能,70亿意味着神经网络中有70亿个参数,由此类推。 在一些大型神经 继续阅读

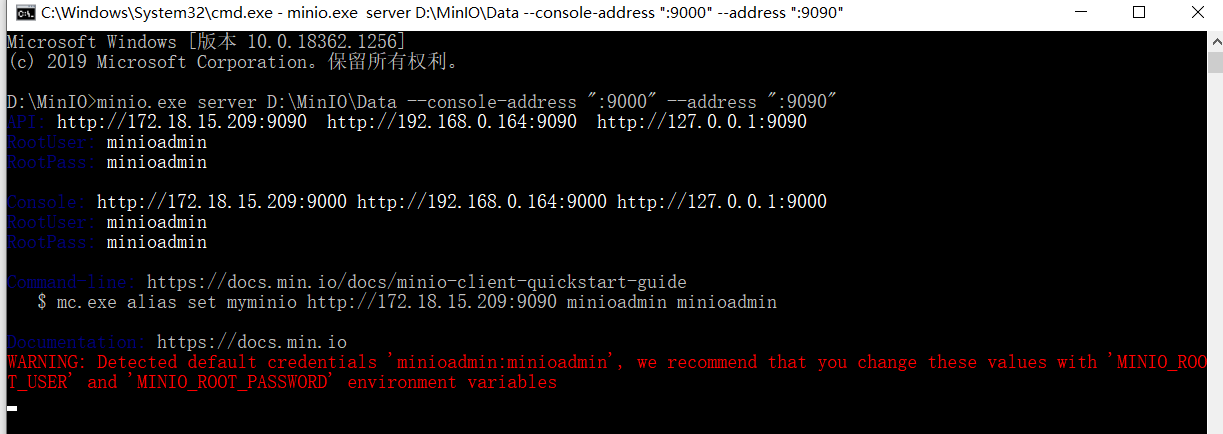

minio:安装部署并安装成windows服务

前言 关于分布式文件存储,之前我也是使用fastdfs,那为什么突然选择minio? 1、它可以多平台部署 2、搭建起来不是很复杂 3、github近30K的star 什么是minio? 构建高性能的云原生数据 机器学习,大数据分析,海量存储的基础架构 MinIO支持各种应用程序数据工作负载 在中国:阿里巴巴、腾讯、百度、中国联通、华为、中国移动等等9000多家企业也都在使用MinIO产品 继续阅读

chatgpt + 飞书 一个完整可部署的学习项目

文章目录前言一、chatgpt是什么?二、用例三、项目展示总结 前言 随着人工智能的不断发展,机器学习这门技术也越来越重要,很多人都开启了学习机器学习,博主挖掘了一个 chatgpt + 飞书 的一个开源项目,可直接部署学习使用。 一、chatgpt是什么? ChatGPT是OpenAI开发的一个大型预训练语言模型。是一种基于神经语言处理技术来生成聊天机器人的语料库, 继续阅读

应用的集群部署

基本附和 魔力猫咪 的观点。 [quote]主要看具体是什么集群。现在有些用F5之类的负载均衡器的应用也被叫做集群,还有双机热备(部分人也把它叫集群,其实只有一台机器在工作,另一台是备份机,平时不参与业务,只有主机不能提供服务的时候,备份机采工作)。还有用一些JVM集群缓存软件构件的集群。这些集群每台机器一般都需要单独部署。因为使用F5负载均衡和双机热备的,其实是一 继续阅读