GPT1:Imporoving Language Understanding By Generative Pre-training GPT2:Lanuage Models Are Unsupervised Multitask Learners GPT3:Language Models Are Few-shot Learners GitHub:https://github.com/openai/gpt-3 从GPT三个版本的论文名也能看出各版本模型的重点: GPT1:强调预训 继续阅读

Search Results for: Training

查询到最新的11条

TeamsApp 和 ChatGPT 的几种结合方法

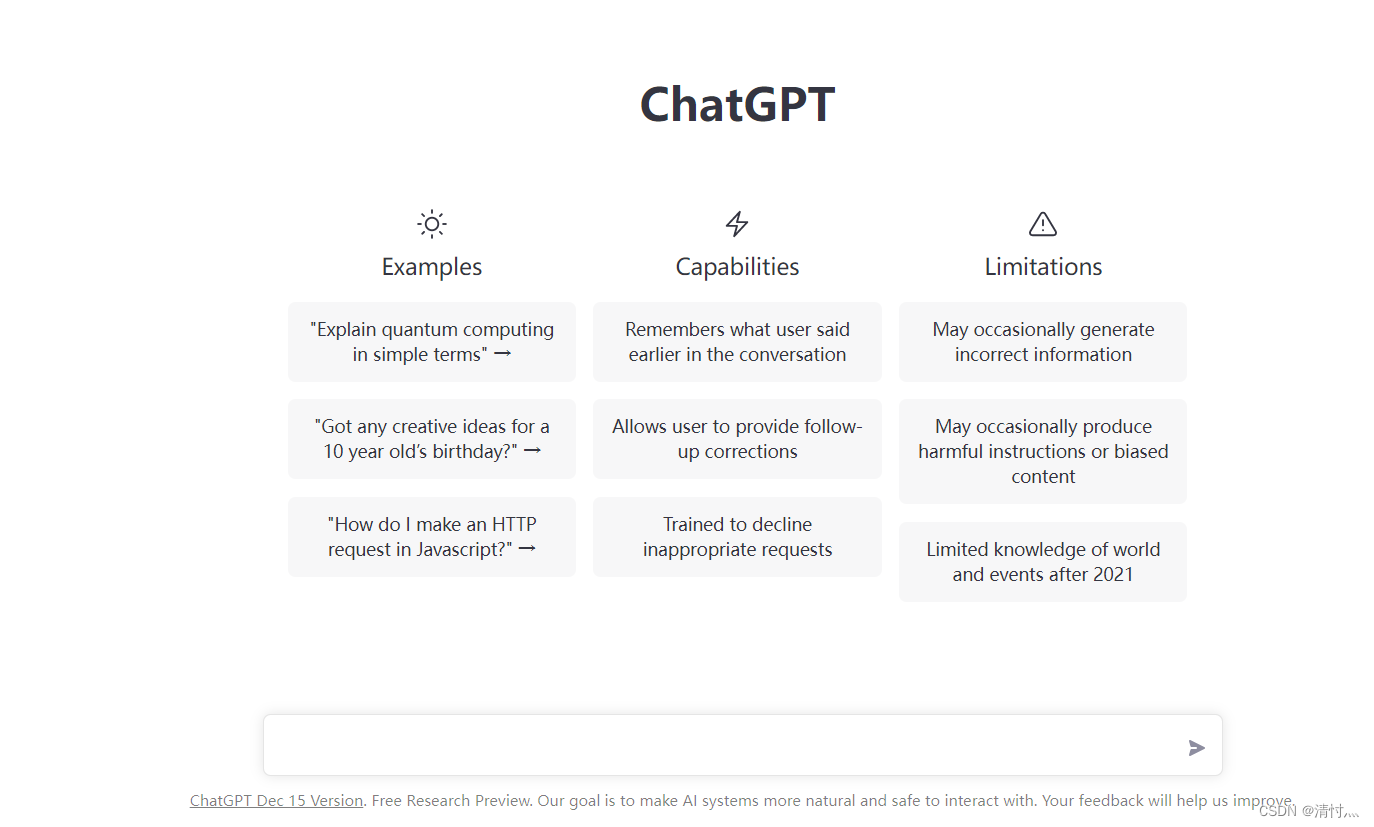

ChatGPT (Conversational Generative Pre-training Transformer) 是由 OpenAI 开发的一种大型语言模型,它可以自然地生成人类语言,并用于聊天机器人、对话系统、自动文本生成等应用。ChatGPT 使用了 Transformer 模型作为其架构的基础,这种模型可以处理长输入并具有较高的并行性。它还使用了诸如 masked language modeling 和 next sentence pred 继续阅读

ChatGPT自动化

目录一、前言 二、Selenium反反爬操作2.1、隐藏“正在受到自动软件的控制” 2.2、禁用 Blink 渲染引擎2.3、Cookies 和 UA伪装 2.4、控制已打开的浏览器三、自动化操作3.1、问题遍历3.2、获取回答四、源码一、前言近日, ChatGPT在圈内大火。那么什么是ChatGPT呢?ChatGPT是一种自然语言生成模型,由OpenAI开发。它基于GPT(Generative Pre-training Tran 继续阅读

ChatGPT和代码智能

一. ChatGPT 1. ChatGPT的自我介绍 2. ChatGPT的前世 2.1GPT-3是啥? General Pre-Training(GPT),即通用预训练语言模型,是一种利用Transformer作为特征抽取器,基于语言模型进行训练的预训练语言模型。所以,理解GPT主要熟悉两个方面即可,即语言模型和其由Transformer组成的结构。将无监督学习有监督模型的预训练目标࿰ 继续阅读

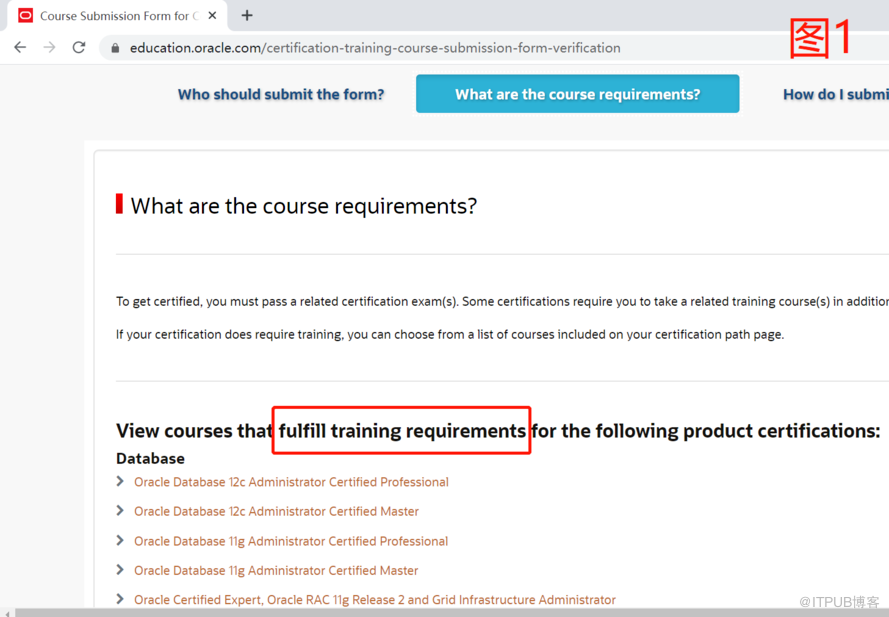

Oracle OCP OCM 和 Mysql OCP考试详情介绍

哪些考试需要hands on,也就是需要有培训记录才能考试的,见下图1 https://education.oracle.com/certification-training-course-submission-form-verification Mysql考试科目列表, Mysql的考试都不要hands on,不需要参加培训,直接在VUE网站购买考试券就可以考试 https://education.oracle.com 继续阅读

【自然语言处理】【大模型】DeepMind的大模型Gopher

DeepMind的大模型Gopher 《Scaling Language Models: Methods, Analysis & Insights from Training Gopher》 论文:https://arxiv.org/pdf/2112.11446.pdf 一、简介 使用自然语言进行交流是智能的核心,因为其可以在人类和人工智能系统之间有效地分享想法。语言的普遍性使我们能够使用自然语言输入来表达许多智能任务,并产生 继续阅读

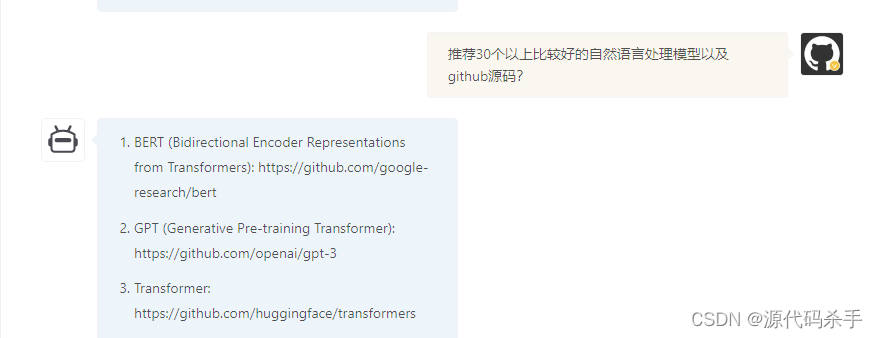

【回答问题】ChatGPT上线了!推荐30个以上比较好的自然语言处理模型

【回答问题】ChatGPT上线了!推荐40个以上比较好的自然语言处理模型以及github源码? BERT (Bidirectional Encoder Representations from Transformers): https://github.com/google-research/bert GPT (Generative Pre-training Transformer): https://github.com/openai/gpt-3 Transfo 继续阅读

ChatLaw:中文法律大模型

文章目录 Abstract1. Introduction2. Dataset3. Training Process3.1 ChatLaw LLM3.2 Keyword LLM3.3 Law LLM 4. Experiment and Analysis5. Conclusions Abstract LLM已经展现出在各个领域彻底改变自然语言处理任务的潜力,引发了人们对特定于垂直领域的大模型的极大兴趣。然而,与BloombergGPT和Fi 继续阅读

gpt做PPT

在计算机科学的不同领域中,技术热潮必然获得扩展。在深度学习和人工智能领域,Transformers模型,尤其是OpenAI的GPT(Generative Pretraining Transformer)系列模型,在NLP(自然语言处理)领域具有重要影响力。本篇文章将聚焦于OpenAI的较新版本模型——ChatGPT在PPT制作中的应用场景。 ChatGPT,是GPT模型的一个应用实例, 继续阅读

【自然语言处理】【大模型】Chinchilla:训练计算利用率最优的大语言模型

Chinchilla:训练计算利用率最优的大语言模型 《Training Compute-Optimal Large Language Models》 论文地址:https://arxiv.org/pdf/2203.15556.pdf 一、简介 近期出现了一些列的大语言模型(Large Language Models, LLM),最大的稠密语言模型已经超过了500B的参数。这些大的自回归transformers已经在各个任务上展现 继续阅读

“万字长文教你如何做出ChatGPT“学习总结

最近chatgpt太火了,对它的原理很是好奇,翻到一篇牛人大作“万字长文教你如何做出ChatGPT”,拜读后记录一个自己理解的内容。1. GPT或者说GPT1.0是什么GPT(Generative Pre-trained Transformer),其实是Generative Pre Training of a language model,可以简单地把语言模型理解为“给定一些字或者词,预测下一个字或者词的模型”。 继续阅读