简介 随着数据科学领域的深入发展,大型语言模型—这种能够处理和生成复杂自然语言的精密人工智能系统—逐渐引发了更大的关注。 LLMs是自然语言处理(NLP)中最令人瞩目的突破之一。这些模型有潜力彻底改变从客服到科学研究等各种行业,但是人们对其能力和局限性的理解尚未全面。 LLMs依赖海量的文本数据进行训练,从而能够生成极其准确的预测和回应。像GPT-3和T5这样的LLMs在诸如语言翻译、问答、以及摘要等多个NLP任务中已经 继续阅读

Search Results for: 深入解析大型语言模型

查询到最新的12条

ChatGPT基础知识系列之大型语言模型(LLM)初识

ChatGPT基础知识系列之大型语言模型(LLM)初识 ChatGPT本质是一个对话模型,它可以回答日常问题、挑战不正确的前提,甚至会拒绝不适当的请求,在去除偏见和安全性上不同于以往的语言模型。ChatGPT从闲聊、回答日常问题,到文本改写、诗歌小说生成、视频脚本生成,以及编写和调试代码均展示了其令人惊叹的能力。在OpenAI公布博文和试用接口后,ChatGPT很快以令人惊叹的对话能力“引爆”网络,本文主要从技术角度,梳理ChatGPT背后涉及的技术工作LLM,来阐述其如此强大的原因;同时思考 继续阅读

科技资讯|下一代Bing搜索,使用比ChatGPT更强大的语言模型

微软bing,经常被人遗忘的搜索引擎即将重获新生。正如预期的那样,这家科技巨头周二宣布,它正在与 OpenAI 合作,利用该公司的 AI 技术增强 Bing。然而,微软也有一个惊喜:下一个版本的 Bing 将采用一种新的下一代大型语言模型,该公司声称它比 ChatGPT “更强大”,并且专门设计用于在搜索方面表现出色。微软表示,为新 Bing 提供支持的下一代大型语言模型 继续阅读

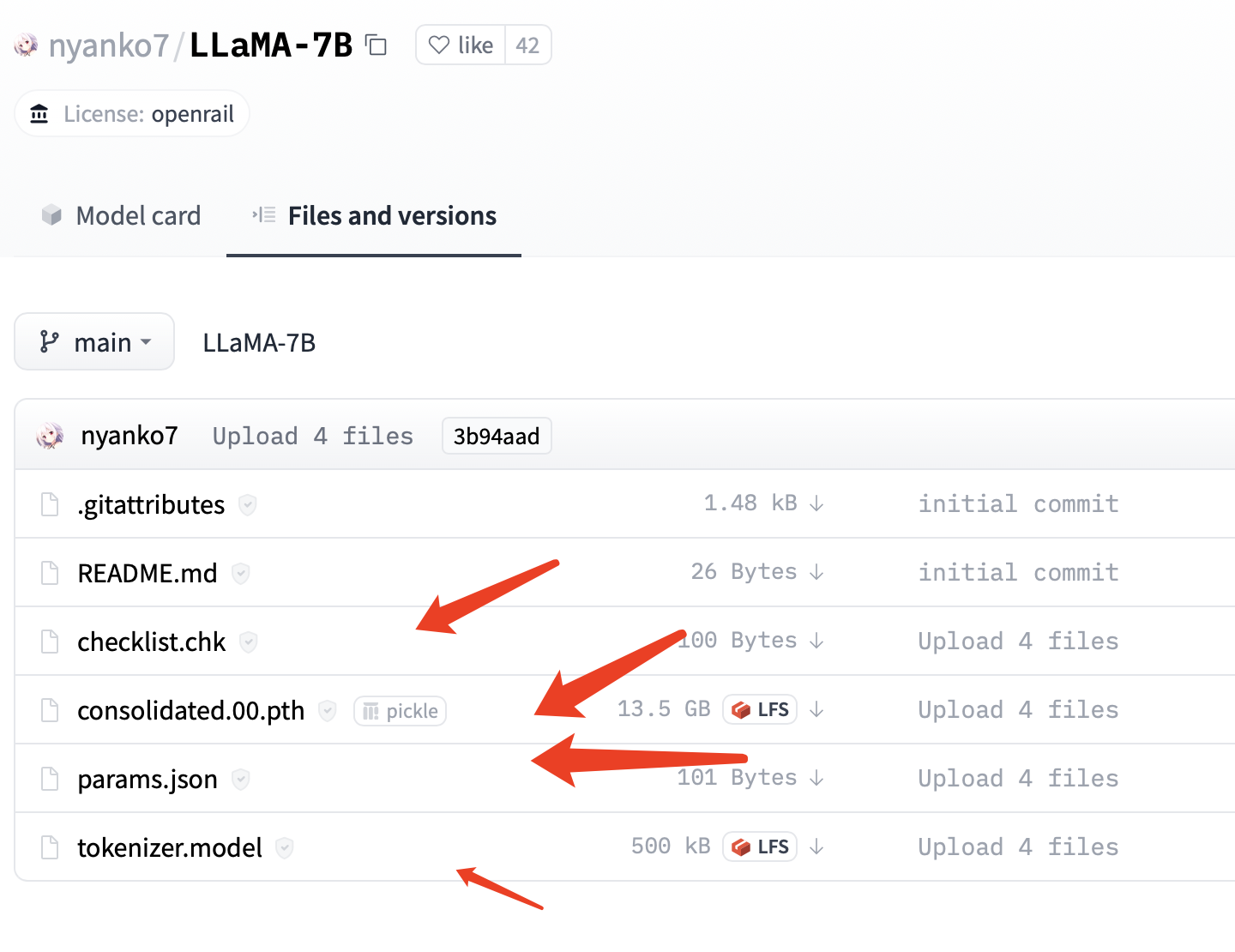

本地推理,单机运行,MacM1芯片系统基于大语言模型C++版本LLaMA部署“本地版”的ChatGPT

OpenAI公司基于GPT模型的ChatGPT风光无两,眼看它起朱楼,眼看它宴宾客,FaceBook终于坐不住了,发布了同样基于LLM的人工智能大语言模型LLaMA,号称包含70亿、130亿、330亿和650亿这4种参数规模的模型,参数是指神经网络中的权重和偏置等可调整的变量,用于训练和优化神经网络的性能,70亿意味着神经网络中有70亿个参数,由此类推。 在一些大型神经 继续阅读

ChatGPT 的工作原理:机器人背后的模型

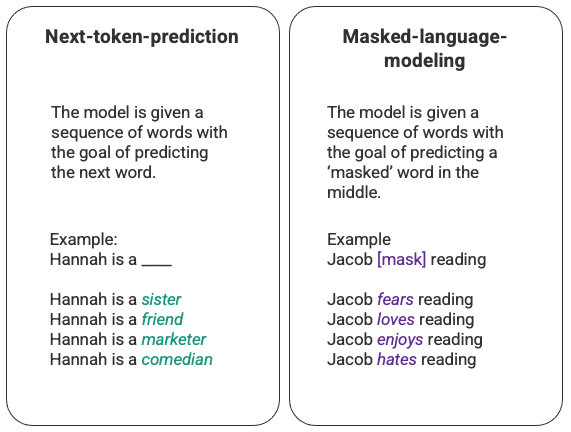

这篇对支持 ChatGPT 的机器学习模型的温和介绍,将从大型语言模型的介绍开始,深入探讨使 GPT-3 得到训练的革命性自我注意机制,然后深入研究人类反馈的强化学习,使 ChatGPT 与众不同的新技术。 大型语言模型 ChatGPT 是一类被称为大型语言模型 (LLM) 的机器学习自然语言处理模型的外推。LLM 消化大量文本数据并推断文本中单词之间的关系。随着我们看到计算能力的进步,这些模型在过去几年中得到了发展。随 继续阅读

深入解析神经网络(Neural Networks)工作原理

目录 1. 神经网络的基本组成部分2. 神经元和激活函数3. 前向传播4. 反向传播5. 神经网络的层次结构6. 神经网络的应用7. 使用Python和TensorFlow库实现简单神经网络 神经网络(Neural Networks)是一种受到生物神经系统启发的人工智能模型,它在计算机科学和机器学习领域发挥着重要的作用。本文将深入解析神经网络的原理和工作原理,包括神经元、前向传播、反向传播以及网络层次结构的构建。 1. 继续阅读

BloombergGPT: 首个金融垂直领域大语言模型

BloombergGPT: 首个金融垂直领域大语言模型 Bloomberg 刚刚发布了一篇研究论文,详细介绍了他们最新的突破性技术 BloombergGPT。BloombergGPT是一个大型生成式人工智能模型,专门使用大量金融数据进行了训练,以支持金融行业自然语言处理 (NLP) 任务。 随着ChatGPT的发布,人工智能取得了长足进步。但金融领域相当复杂且独特的领域,它往往受着严厉的合规监管,对事实正确 继续阅读

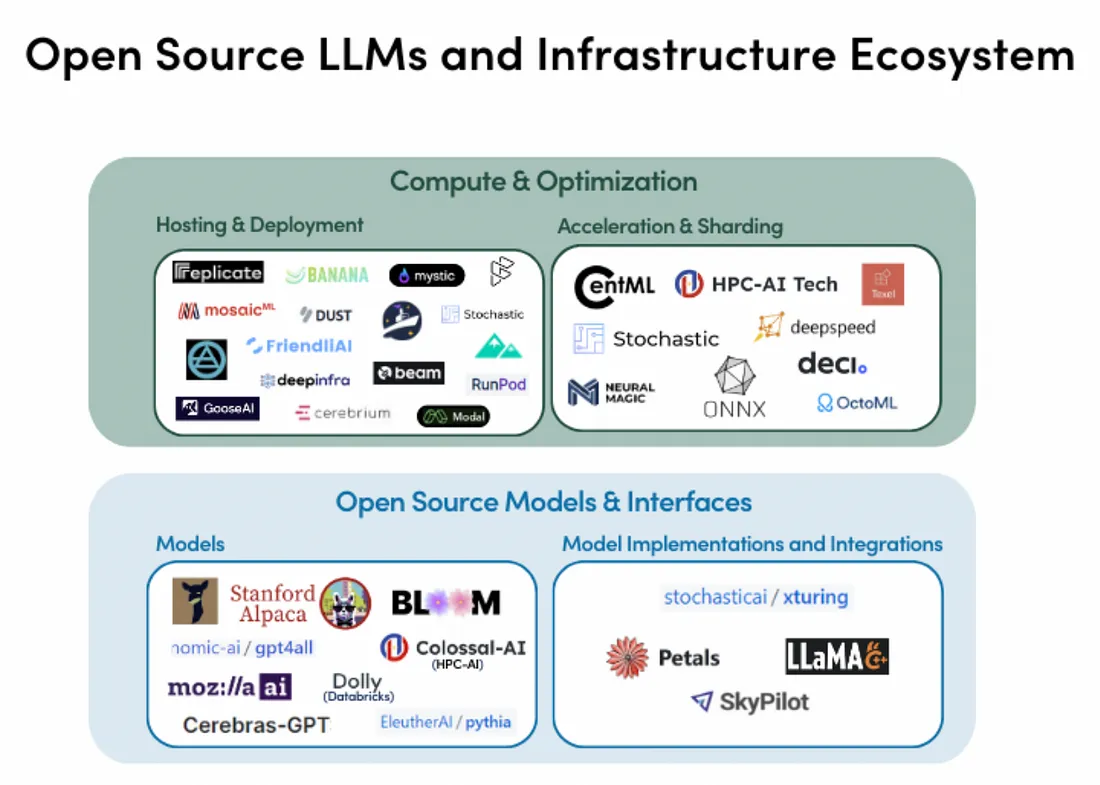

什么是让ChatGPT爆火的大语言模型(LLM)

什么是让ChatGPT爆火的大语言模型(LLM) 更多精彩内容: https://www.nvidia.cn/gtc-global/?ncid=ref-dev-876561 文章目录什么是让ChatGPT爆火的大语言模型(LLM)大型语言模型有什么用?大型语言模型如何工作?大型语言模型的热门应用在哪里可以找到大型语言模型大型语言模型的挑战 AI 应用程序正在总结文章、撰写故事和进行长时间对话——而大型语言模型正在承担繁重的工作。 大型语言模型或 继续阅读

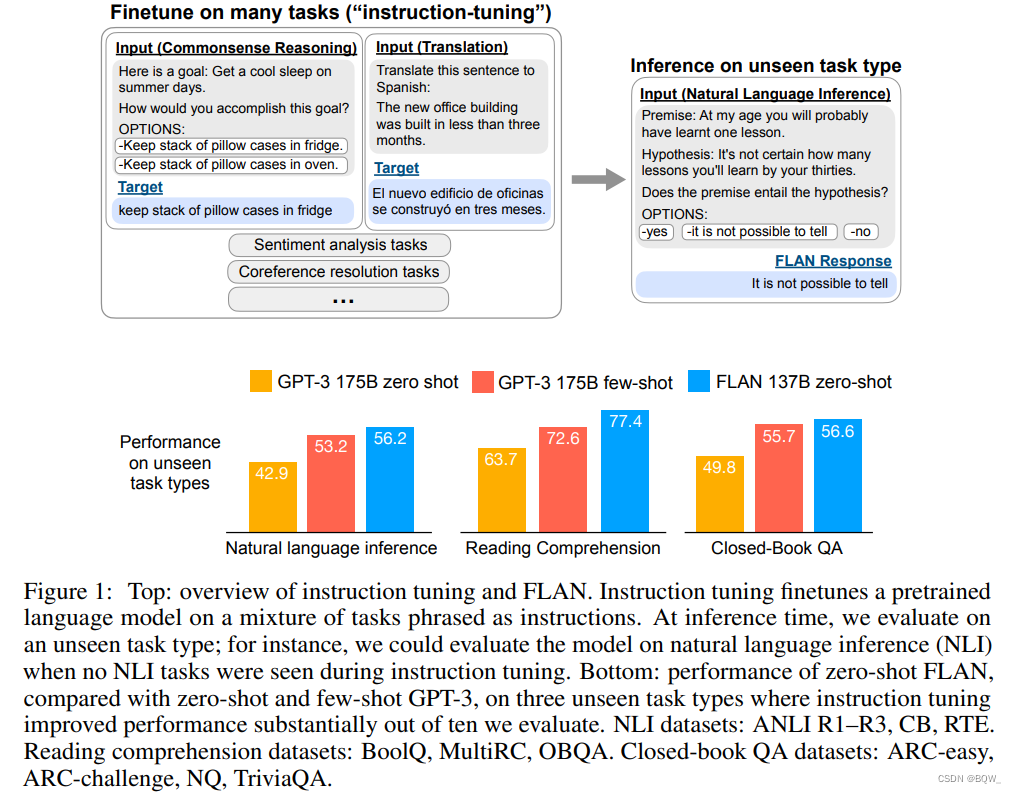

【自然语言处理】【ChatGPT系列】FLAN:微调语言模型是Zero-Shot学习器

FLAN: 微调语言模型是Zero-Shot学习器 《Finetuned Language Models are Zero-shot Learners》 论文地址:https://arxiv.org/abs/2109.01652 一、简介 大语言模型(例如GPT-3\text{GPT-3}GPT-3)已经展现出了非常好的few-shot learning\text{few-shot learning}few-shot learning的能力。然而 继续阅读

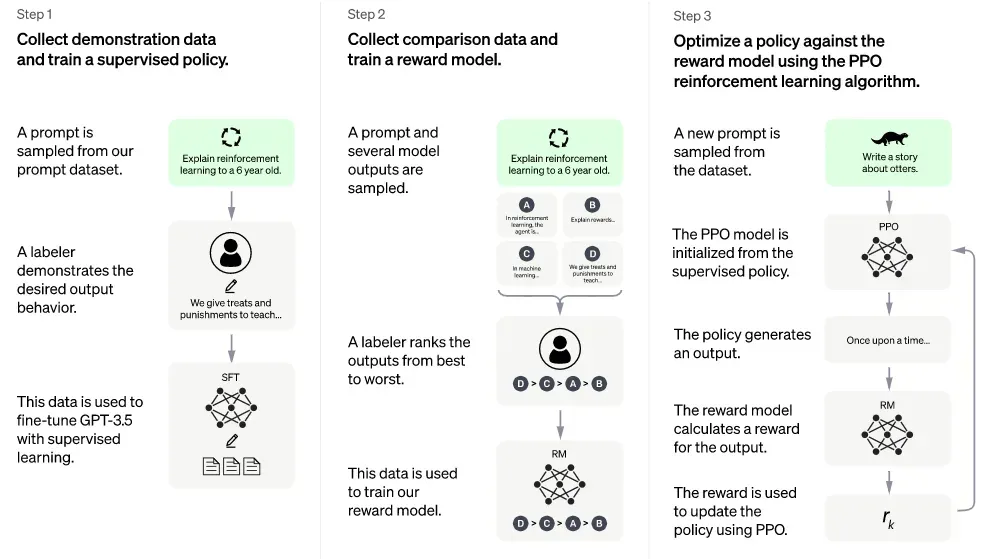

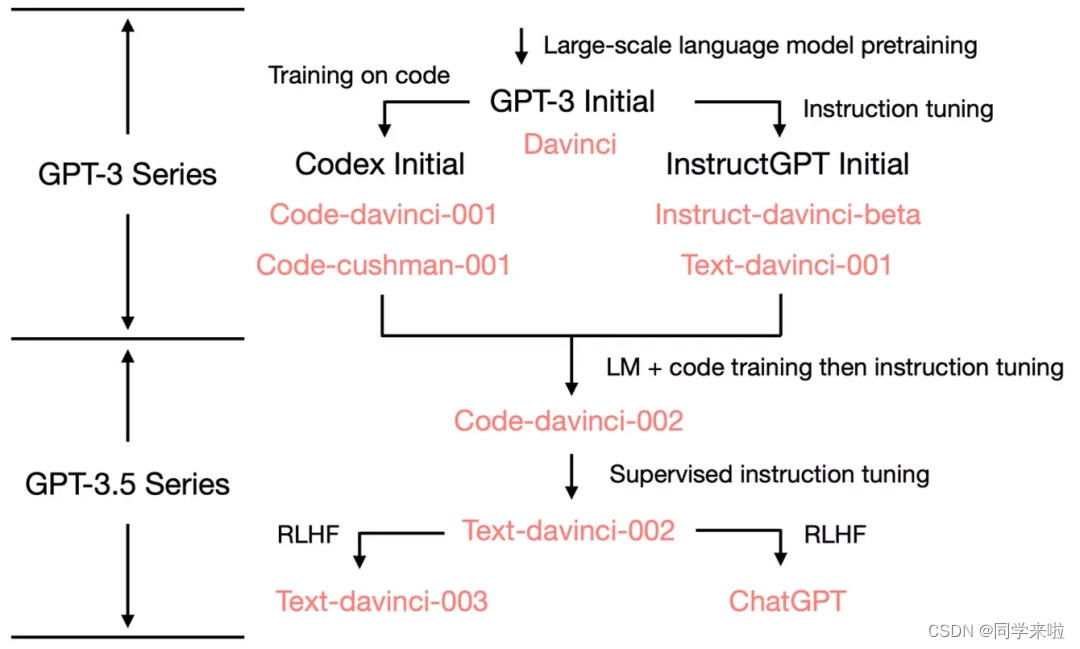

ChatGPT简要解读(三) - ChatGPT发展历程及模型训练机制

文章目录🐣 一、发展历程🔴 1、基本概念🟠 2、演化过程🐤 二、模型训练机制 🐣 一、发展历程 🔴 1、基本概念 ChatGPT是一个采用基于GPT-3.5(Generative Pre-trained Transformer 3.5)架构开发的大型语言模型,与InstructGPT模型是姊妹模型(sibling model&#x 继续阅读

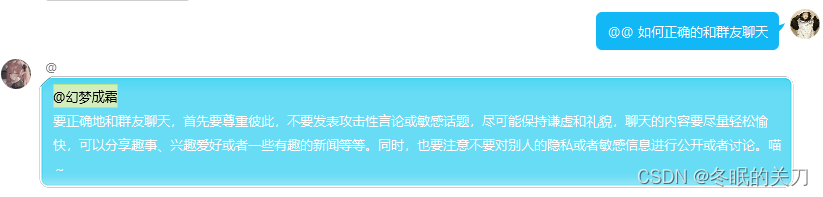

【AI项目实战】某语言模型-stable diffusion-vits-cqhttp 实现能对话能语音能绘画的

好久没写文章了,终于想起来我有个博客账号系列。。 项目已开源在github上。 文章已滤敏,一切涉及语言模型名字的内容都以某语言模型代替 cqhttp 用于接收群友消息,并回复消息。 某语言模型 基于这种对话式的语言模型,可以对用户的聊天进行响应。 目前已额外支持glm离线模型 某语言模型 + stable diffusion 从用户的聊天信息中提取绘画所需的关键词。 SD 衍生功能 权重更换, 继续阅读

ChatGPT背后的模型

文章目录1.RLHF方法2.ChatGPT中的RLHF方法2.1 微调模型GPT-32.2 训练奖励模型2.3 利用强化学习进一步微调语言模型3.效果4.面临挑战5.参考 InstructGPT语言模型,是一个比 GPT-3 更善于遵循用户意图,同时使用通过我们的对齐研究开发的技术使它们更真实、毒性更小。InstructGPT 模型循环迭代的过程当中,加入了人类反馈进行训练。 比如下面的例子:几句话向6岁的孩子解析登月 可以看 继续阅读