【随着模型增大,各方案区别不大】

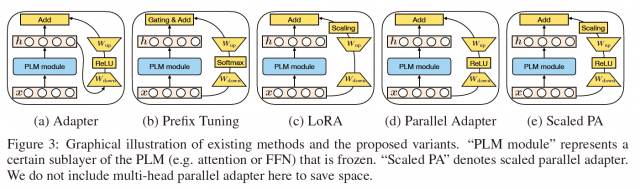

统一框架: 《Towards a Unified View of Parameter-Efficient Transfer Learning》

GitHub - thunlp/PromptPapers: Must-read papers on prompt-based tuning for pre-trained language models.

GitHub - thunlp/DeltaPapers: M

本文链接:https://my.lmcjl.com/post/20871.html

展开阅读全文

4 评论